В 2026 году выбор между HBA и RAID-контроллером — это не спор «что быстрее», а решение о том, где живёт логика надёжности и восстановления: в контроллере или в операционной системе/файловой системе. NVMe-пулы растут, tri-mode адаптеры (SAS/SATA/NVMe) стали обыденностью, а требования к телеметрии, переносимости и плану восстановления стали жёстче.

Разберём на понятном языке определения, матрицу решений, типовые ошибки и чек-лист перед покупкой, чтобы не выяснять нюансы уже после того, как данные «поехали».

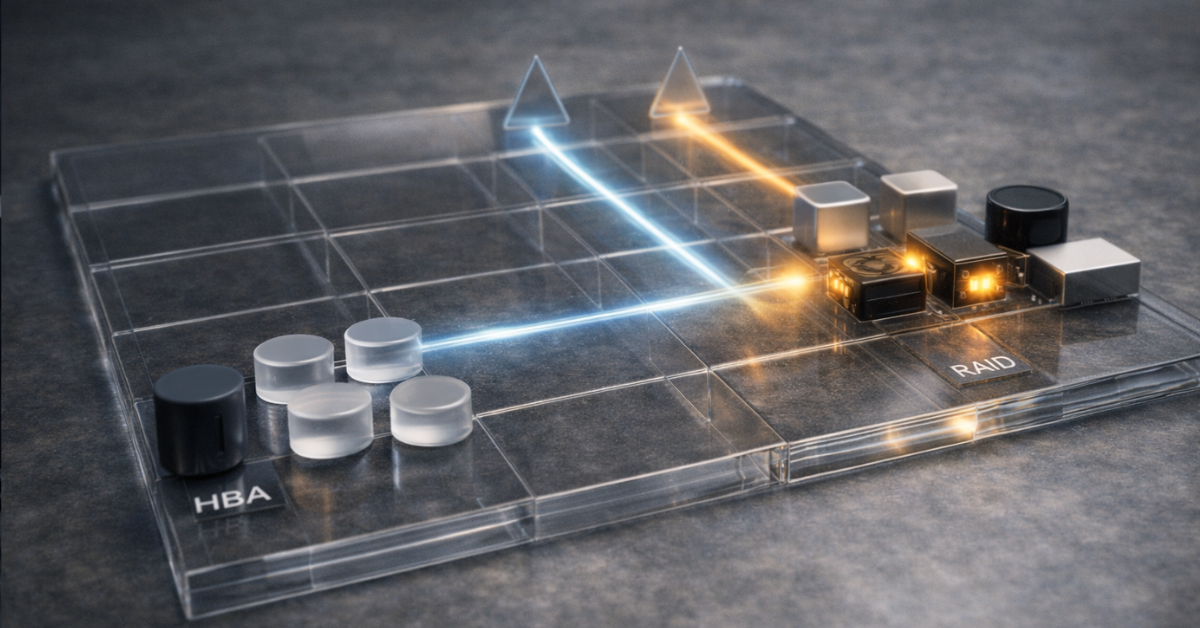

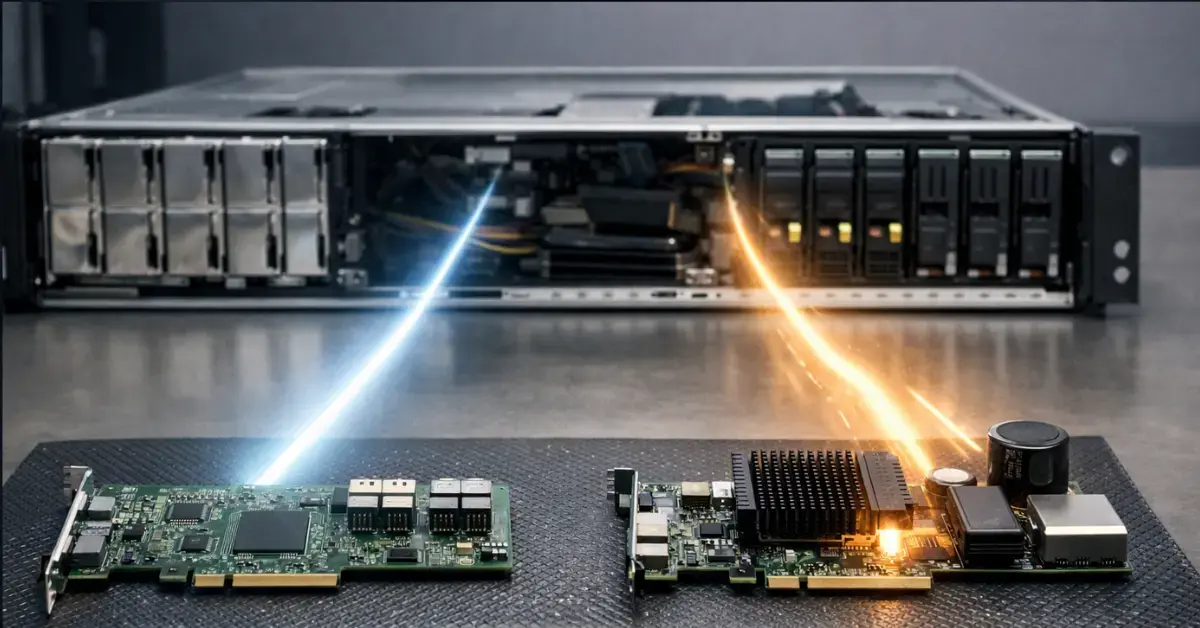

Чем HBA отличается от RAID-контроллера

HBA (Host Bus Adapter) — «прозрачный мост» к дискам. Его задача — подключить накопители и показать ОС диски “как есть”, без создания виртуальных дисков и скрытой логики массива. Это базовый и предпочтительный вариант, когда RAID/устойчивость/проверка целостности делает стек ОС/ФС: ZFS, Ceph, Linux mdadm, Windows Storage Spaces, VMware vSAN.

RAID-контроллер — устройство, которое собирает массивы из "железных" накопителей, создаёт виртуальные диски (VD) и часто даёт сервисные функции: patrol read/consistency check, OCE/RLM (расширение/миграция уровня), кэширование записи (write-back) и управление кэшем через модуль защиты (суперкап/flash-модуль наподобие CacheVault). Для классических сценариев «быстро поднять RAID1/10 под гипервизор/ОС» это может быть проще в эксплуатации — но только при правильной конфигурации кэша и понятном плане восстановления.

«JBOD/HBA-mode на RAID-карте» vs «настоящий HBA»

Многие RAID-карты умеют JBOD или HBA-mode, но это не всегда эквивалент «чистому» HBA:

- в одних семействах это действительно близко к passthrough;

- в других — часть команд и телеметрии может проходить иначе, а некоторые функции (например, TRIM/UNMAP, SMART passthrough) зависят от прошивки/режима/драйвера;

- иногда «JBOD» означает «диск как отдельный объект», но всё равно через слой контроллера с собственными особенностями очередей, таймаутов и обработки ошибок.

- Попадаются советы и вида "сделать RAID 0 из каждого диска, это будет тоже самое что HBA - нет, это не так, управление дисками идёт через контроллер при этом, система не "видит" физических дисков.

Вывод: если архитектура опирается на прозрачность дисков и диагностику на уровне ОС/ФС, «настоящий HBA» проще предсказать.

Почему спорят

Обычно спор сводят к скорости, но на практике важнее:

- целостность данных после аварий (питание, зависания, деградации);

- восстановление после отказа контроллера и переносимость массива;

- телеметрия и обслуживание (SMART, температуры, UNC/Media Errors, scrub/patrol read);

- совместимость с TRIM/UNMAP и особенностями SSD/NVMe.

HBA — про прозрачность и контроль на уровне софта; RAID-контроллер — про железный массив и кэш, но с рисками lock-in и нюансами восстановления.

Что изменилось к 2026: NVMe, tri-mode, PCIe и «железо против софта»

NVMe стало «нормой», а ограничения чаще у платформы

В 2026 производительность массива часто упирается не в «HBA vs RAID», а в:

- линии и поколение PCIe (Gen4/Gen5),

- топологию (куда подключены слоты/бекплейн, есть ли свитчи и где),

- NUMA (локальность к сокету),

- аплинки и oversubscription в бекплейне/свитче.

То есть выбор адаптера нужно рассматривать вместе с платформой: какой слот (x8/x16), какая разводка, куда «смотрит» бекплейн.

Tri-mode: один адаптер для SAS/SATA/NVMe

Tri-mode устройства стали массовыми: один контроллер/адаптер может работать с SAS, SATA и NVMe в зависимости от бекплейна и кабелей. У Broadcom это выделено как класс решений (и для eHBA, и для RAID-линеек): например, материалы по 9600 Series и tri-mode HBA показывают сам подход и модели устройств.

Вы можете собрать сервер, где часть корзин — SAS HDD под объём, часть — NVMe под горячие данные, при этом сохраняя единый класс адаптера и понятный кабельный стек (но важно проверить совместимость бекплейна и разъёмов).

NVMe RAID «без карты»: Intel VROC (VMD)

Отдельная ветка — NVMe RAID через платформу Intel: Intel VROC (Virtual RAID on CPU), который работает вместе с VMD (Volume Management Device). Это не просто «программа»: часть логики завязана на платформенные возможности, поддерживаемые CPU/чипсетом/BIOS и конкретными NVMe SSD, а также на лицензировании функций (в зависимости от конфигурации и требований). Официальные материалы: обзор VROC и документ по поддерживаемым конфигурациям/нюансам лицензирования.

К 2026 “выбор контроллера” — это часть общей стратегии хранения, где NVMe/PCIe/tri-mode и переносимость важнее «магических процентов скорости».

Надёжность данных: где реально больше гарантий

Чтобы не спорить лозунгами, разделим «надёжность» по слоям: кэш записи, консистентность при сбое питания, сквозная целостность и диагностируемость.

Write-back кэш и защита кэша

Write-back ускоряет запись, потому что подтверждает операции раньше: данные временно лежат в кэше контроллера (DRAM), а на диски «доезжают» позже. Это полезно, но опасно: потеря питания/сбой контроллера в момент, когда данные ещё в кэше, может привести к потере подтверждённых записей и логической порче файловых структур.

Поэтому критичен вопрос cache protection: модули, которые при потере питания дают контроллеру время сохранить содержимое DRAM-кэша в энергонезависимую память (NAND/flash). Broadcom описывает принцип CacheVault и саму идею защиты write-back кэша (например, CacheVault overview, а также материалы о выборе решений и смысле защищённого кэша.

Практическое правило:

- RAID-контроллер без защиты кэша + включённый write-back = высокий риск.

- если защиты нет — write-back должен быть отключён, а ожидания по производительности — пересмотрены.

RAID-контроллер «хорош» не сам по себе, а когда write-back защищён и предсказуем.

Write hole и консистентность после падения питания

Для RAID5/RAID6 критичны частичные записи: если питание пропало между записью данных и паритета, массив может оказаться в состоянии, где паритет не соответствует данным (классический write hole). Железный RAID частично решает это за счёт кэша/журналирования, но фундаментально проблема — про атомарность обновления данных+паритета.

В софт-RAID в Linux есть механизмы, уменьшающие риск: write-intent bitmap, а также режимы журналирования/partial parity log (PPL) — это описано в руководстве по md и в документации mdadm.

В 2026 софт-RAID давно не “игрушка”, а стек с понятными механизмами консистентности, но их нужно включать и обслуживать.

Сквозная целостность и прозрачность для ФС

ZFS — это не только «RAID-Z», а в первую очередь сквозная проверка целостности: контрольные суммы, самовосстановление при наличии избыточности, scrub как регулярная практика. Для этого ZFS важно видеть диски напрямую, получать корректную информацию об ошибках/таймаутах и управлять поведением устройств.

Если вы строите надёжность на ZFS/Ceph/другом софт-стеке, прозрачность дисков важнее, чем “умный” контроллер.

Производительность: мифы и реальность (особенно для SSD/NVMe)

Где RAID-контроллер реально помогает

- HDD и смешанные профили записи: защищённый write-back кэш может сильно улучшить latency и throughput при мелких синхронных записях (журналы, метаданные, VM-логика), особенно на HDD/гибридных массивах.

- Эксплуатационные функции: при «классическом RAID» удобно иметь patrol read/consistency check и управляемые операции миграции/расширения (если вы живёте в парадигме VD и вам это подходит).

Важно: выигрыши от «разгрузки CPU» сегодня часто не являются главным фактором — CPU и память на серверах выросли, а bottleneck всё чаще в топологии PCIe/свитчах/бекплейне, а не в вычислении паритета.

Где HBA + software RAID чаще выигрывает эксплуатационно

- Предсказуемая латентность: меньше «сюрпризов» от контроллера, проще тюнить очереди и планировщик ввода-вывода на стороне ОС.

- Лучшая наблюдаемость: проще получать SMART, видеть реальные ошибки и поведение каждого диска.

- Управляемое восстановление: для ZFS/mdadm обычно проще переносить диски и поднимать массив на другом хосте без поиска «точно такого же» контроллера.

NVMe: часто решает не RAID, а PCIe-путь

Если NVMe «не летит», проверьте базовые вещи до смены адаптера:

- слот действительно x16/x8, а не физический x16 при электрическом x8;

- Gen4/Gen5 согласованы (BIOS, ретаймеры, качество линий);

- бекплейн не сидит за PCIe-свитчом с жёстким oversubscription;

- NVMe устройства не «уехали» на другой сокет (NUMA), а ваш workload чувствителен к этому.

RAID-контроллер может ускорить HDD-профили за счёт защищённого кэша, но для SSD/NVMe чаще важнее топология PCIe и эксплуатационная предсказуемость.

Эксплуатация и восстановление: то, что обычно забывают

Переносимость и vendor lock-in

Главный практический вопрос: что будет, если контроллер умер?

- Для аппаратного RAID массив часто завязан на метаданные и формат конкретного семейства. Иногда помогает «похожий» контроллер того же поколения, иногда — только строго совместимая модель/прошивка. Чем сложнее конфигурация (несколько VD, кэш-политики, SED, нестандартные параметры), тем выше риск, что восстановление превратится в поиск «того самого» железа.

- Для HBA + ZFS/mdadm диски обычно остаются «понятными» другому хосту: вы переносите накопители, поднимаете пул/массив (с учётом версий и аккуратных процедур импорта), и не зависите от контроллера как от «ключа к данным».

Практика: если для бизнеса критичен быстрый recovery, аппаратный RAID должен идти вместе с планом совместимого ЗИП (минимум — запасной контроллер того же семейства) и заранее проверенной процедурой восстановления.

Стоимость контроллера — это ещё и стоимость зависимости от него.

Мониторинг и телеметрия (SMART, ошибки, температуры)

Для предиктивного обслуживания важно видеть:

- растущие значения ошибок чтения/перезаписи,

- UNC/media errors,

- температуры и «дрейф» поведения,

- таймауты и «нестабильные» диски, которые ещё не умерли, но уже портят жизнь массиву.

На HBA это обычно проще: ОС видит устройства напрямую. На RAID-контроллере многое зависит от режима, драйвера и того, как организован passthrough SMART и ошибок.

TRIM/UNMAP

Для SSD/NVMe важна поддержка освобождения блоков (TRIM/UNMAP). В реальности она может ломаться на уровнях «контроллер → виртуальный диск → ОС». У Broadcom встречаются материалы и практические ограничения по UNMAP/DSM/TRIM в зависимости от режимов и стека (вендорские KB/руководства — ориентир при подборе).

Практическое правило: если ваш workload активно удаляет/перезаписывает данные (VM-диски, базы, CI-кэши), проверяйте TRIM/UNMAP в выбранном режиме до запуска в прод.

Обслуживание массивов: patrol read/consistency vs scrub/checkarray

- На аппаратном RAID полезны patrol read и consistency check как регулярные процедуры для раннего выявления проблем и поддержания целостности.

- В ZFS — регулярный scrub.

- В mdadm/Linux — проверки массива и мониторинг состояния.

Выбор HBA/RAID — это выбор модели эксплуатации. Если нет процесса мониторинга и регулярных проверок, “железный RAID” сам по себе не спасает.

Типовые сценарии 2026: что выбрать

TrueNAS/FreeBSD/OpenZFS NAS

Рекомендация: HBA (passthrough/IT), без аппаратного RAID.Почему: ZFS рассчитывает на прямой доступ к дискам, прозрачность ошибок и свою модель целостности.На что смотреть: корректная телеметрия, стабильные таймауты, достаточные PCIe-линии, совместимость бекплейна.

Ceph (и близкие SDS-архитектуры)

Рекомендация: HBA.Почему: Ceph и SDS-подходы предполагают, что устойчивость и восстановление — на уровне софта/кластера, а диски должны быть максимально «честными».На что смотреть: одинаковые профили дисков, предсказуемая латентность, достаточная сеть, мониторинг.

Proxmox + ZFS

Рекомендация: HBA.Почему: ZFS в гипервизоре требует прямых дисков и понятного восстановления; аппаратный RAID добавляет слой абстракции, ухудшая диагностику и переносимость.Оговорка: RAID-карта допустима только если у неё есть действительно корректный HBA/JBOD режим и вас устраивает телеметрия/поведение — но это уже “тонкая настройка”, а не дефолт.

VMware/Hyper-V и «классический» RAID1/10 под гипервизор

Рекомендация: чаще RAID-контроллер с защищённым write-back кэшем.Почему: если вы не строите SDS и хотите быстрое, понятное RAID-зеркало/stripe-mirror под VMFS/NTFS/ReFS, железный RAID может дать простую эксплуатационную модель.На что смотреть: наличие cache protection (уровня CacheVault/аналог), понятные процедуры rebuild, регулярные patrol read/consistency check, совместимость с вашей ОС и утилитами управления.

Windows Storage Spaces / Storage Bus Cache

Рекомендация: HBA/JBOD, устойчивость и кэширование — на стороне Windows.Почему: Storage Spaces и Storage Bus Cache — это программная модель хранения, где быстрые носители могут выступать кэшем для медленных, а управление и эффективность определяются Windows-стеком.На что смотреть: корректная поддержка устройств, одинаковость дисков по классам, телеметрия, драйверы.

VMware Virtual SAN

Рекомендация: Аналогично предыдущему пункту - HBA/JBOD, отказоустойчивость, кеширование и дедупликацией будет заниматься система VMware.Почему: VSAN — также программная модель хранения, где может быть реализовано многослойное хранение (с кэшем на быстрых накопителей) или all-flash массив.На что смотреть: Обязательна проверка по HCL от VMware, вплоть до конкретных версий прошивок накопителей.

NVMe boot / NVMe RAID на Intel-платформе

Рекомендация: рассмотреть Intel VROC при наличии требований, совместимости и лицензий.Почему: VROC завязан на VMD/платформу и матрицу поддерживаемых SSD/ОС, плюс возможны ограничения по сторонним SSD и включению функций.На что смотреть: список поддерживаемых конфигураций, требования OEM/BIOS, политика лицензирования, сценарий восстановления.

Если надёжность у вас “в софте” (ZFS/Ceph/Storage Spaces/VSAN) — берите HBA; если нужен простой аппаратный массив под гипервизор — берите RAID, но только с защищённым write-back.

HBA vs RAID-контроллер — сравнение

| Критерий | HBA | RAID-контроллер |

| Прозрачность дисков для ОС/ФС | Максимальная: диски видны напрямую | Слои абстракции: VD/массив, passthrough зависит от режима |

| Сквозная целостность на уровне ФС | Идеально для ZFS/софт-стека | Может скрывать детали ошибок/поведения дисков |

| Write-back кэш | Обычно нет «умного» кэша на карте | Есть, но опасен без защиты; ценен с cache protection |

| Производительность на HDD-записях | Зависит от софт-стека | Часто выше при защищённом write-back |

| Производительность SSD/NVMe | Часто упирается в PCIe/топологию | Тоже упирается в PCIe; выигрыш не гарантирован |

| TRIM/UNMAP passthrough | Обычно проще и прозрачнее | Может зависеть от прошивки/режима/драйвера |

| Мониторинг SMART/ошибок | Обычно проще | Зависит от режима; иногда видимость хуже |

| Переносимость при смерти контроллера | Обычно выше (ZFS/mdadm читаемы на другом хосте) | Риск vendor lock-in и необходимости совместимого контроллера |

| Восстановление | Предсказуемее, но требует дисциплины в софт-стеке | Может быть проще «внутри экосистемы», но сложнее при отказе контроллера |

| Стоимость/энергопотребление | Обычно ниже | Выше, особенно с модулями защиты кэша |

| Лучшие сценарии | ZFS/TrueNAS, Ceph, mdadm, Storage Spaces/VSAN | Классический RAID1/10 под ОС/гипервизор, когда нужен защищённый write-back |

Сценарий → рекомендация → почему → критичные требования

| Сценарий | Рекомендация | Почему | Критичные требования |

| TrueNAS/OpenZFS | HBA | ZFS нужна прозрачность дисков | SMART/ошибки, стабильные таймауты, scrub |

| Ceph | HBA | Устойчивость на уровне кластера/софта | Наблюдаемость, предсказуемая латентность |

| Proxmox (ZFS) | HBA | Диагностика и переносимость важнее «железного массива» | PCIe/NUMA, scrub, мониторинг |

| VMware/Hyper-V без SDS | RAID-контроллер с cache protection | Простой «классический RAID» + защищённый write-back | CacheVault/аналог, patrol read, план ЗИП |

| Windows Storage Spaces / Storage Bus Cache | HBA/JBOD | Кэш/устойчивость в Windows-стеке | Совместимость устройств, драйверы, телеметрия |

| VMware Virtual SAN | HBA/JBOD | Обработка производится ПО, нужен прямой доступ к дискам | Наличие дисков и контроллеров в HCL, лицензии |

| NVMe RAID boot (VROC) | VROC при совместимости | Платформенный NVMe RAID с нюансами поддержки/лицензий | Матрица SSD/ОС, лицензии, BIOS/VMD |

Чек-лист выбора железа

- Интерфейсы и бекплейн

- какие корзины: SAS/SATA/NVMe;

- есть ли SAS expander и как он влияет на полосу;

- типы разъёмов и кабелей (SFF-8654, SlimSAS, OCuLink) и их соответствие бекплейну;

- если нужен tri-mode — проверьте, что адаптер и бекплейн действительно рассчитаны на смешанные протоколы.

- PCIe и топология

- слот x8/x16 и поколение Gen4/Gen5;

- куда подключён слот относительно сокетов (NUMA);

- нет ли «узкого горлышка» свитча/ретаймера/аплинка.

- JBOD/HBA-mode “из коробки”

- нужен режим passthrough без экзотических процедур;

- заранее убедитесь, что в выбранной ОС есть нормальные утилиты и драйвер.

- Кэш и защита кэша (для RAID-контроллера)

- есть ли cache protection и какого типа (суперкап + флэш/модуль);

- понятны ли политики write-back и поведение при потере питания.

- Инструменты управления и обновления

- утилиты (StorCLI/аналог), телеметрия, экспорт метрик;

- политика обновления прошивок и совместимость с вашей ОС.

- Шифрование/SED (если нужно)

- поддержка TCG/SED, как управляются ключи;

- как это влияет на recovery и перенос дисков.

Покупка “правильной карты” не компенсирует неправильный бекплейн/PCIe-топологию и отсутствие защиты кэша.

Ошибки, которые стоят дороже всего

- ZFS поверх аппаратного RAID Двойная абстракция: ZFS теряет часть прозрачности дисков, сложнее диагностика, выше риск неожиданных эффектов при ошибках и восстановлении. Если нужен ZFS — используйте HBA, как рекомендует OpenZFS.

- Write-back без защиты кэша Самый частый «дорогой» промах: производительность кажется отличной — до первого сбоя питания или зависания, после чего появляются повреждения данных.

- “Сделаю как HBA”: один диск = RAID0 Так часто пытаются «обмануть» RAID-карту. Итог: остаётся слой контроллера, возможны ограничения по TRIM/SMART/ошибкам, а переносимость и восстановление не становятся лучше. Если вам нужен HBA — берите HBA или гарантированный HBA-mode.

- Игнорировать TRIM/UNMAP и телеметрию На SSD/NVMe это может привести к деградации производительности и неожиданным проблемам в эксплуатации.

- Нет запасного контроллера или плана миграции Если архитектура завязана на конкретный RAID-контроллер, запасной совместимый контроллер и проверенная процедура восстановления — часть дизайна, а не «опция на потом».

Итог

- ZFS/TrueNAS/Ceph/mdadm/Storage Spaces/VSAN → HBA.Надёжность и восстановление у вас в софте, диски должны быть прозрачными и диагностируемыми.

- Нужен простой аппаратный RAID под ОС/гипервизор и важен защищённый write-back → RAID-контроллер с cache protection.Без защиты кэша write-back превращается в риск.

- NVMe RAID на Intel-платформе → оценить VROC (VMD), совместимость и лицензии.Смотрите официальные материалы Intel: VROC и Supported Configs PDF.

- Всегда просчитывайте нюансы эксплуатации: мониторинг, процедуры проверок (scrub/patrol read), запасные компоненты и сценарий recovery. Выбор контроллера — это не «железка», а часть стратегии DR и управляемости.

Нажимая кнопку «Отправить», я даю согласие на обработку и хранение персональных данных и принимаю соглашение