PCIe давно перестал быть характеристикой, которую можно оценивать по принципу «чем новее поколение, тем лучше». Для современной серверной платформы это уже не просто шина расширения, а один из элементов общей архитектуры ввода-вывода. На практике итоговую производительность определяют не только 16 GT/s у PCIe 4.0 и 32 GT/s у PCIe 5.0, но и то, сколько линий реально доступно устройству, как устроена топология платы, к какому сокету привязан слот, проходит ли трафик через чипсет, хватает ли охлаждения и не упирается ли вся система в контроллер, память или программный стек. PCI-SIG прямо указывает, что PCIe 4.0 добавляет 16,0 Гбит/с на линию в одном направлении, а PCIe 5.0 — 32,0 Гбит/с, то есть пятое поколение действительно удваивает сырую пропускную способность относительно четвертого. Но из этого не следует, что приложение, сервер или конкретное устройство ускорятся вдвое.

Именно поэтому тема PCIe Gen4 и Gen5 сейчас особенно важна. Современные серверы одновременно несут на себе быстрые NVMe-накопители, 100/200/400GbE-сетевые карты, GPU и ускорители, а также плотные I/O-конфигурации в виртуализации, SDS и AI/HPC. В такой среде PCIe становится не фоном, а ограничителем: ошибка в выборе слота, ширины подключения или топологии может оказаться важнее самого факта наличия Gen5 на коробке. Это особенно заметно в системах, где нужно не просто получить пиковый throughput, а обеспечить устойчивую latency и предсказуемое поведение под нагрузкой.

Что означает пропускная способность PCIe на практике

PCIe устроен как набор последовательных линий, или lanes. Каждая линия передает данные независимо, а итоговая пропускная способность формируется из поколения интерфейса и количества линий: x1, x4, x8, x16. Поэтому сравнивать только Gen4 и Gen5 некорректно. PCIe 5.0 x4 и PCIe 4.0 x8 близки по классу доступной пропускной способности, а PCIe 5.0 x8 уже сопоставим по «емкости канала» с PCIe 4.0 x16. Именно эта логика важна в серверной архитектуре: считать нужно не абстрактное поколение, а связку «версия × ширина × реальная схема подключения». Intel в своих поясняющих материалах также подчеркивает, что каждое поколение PCIe удваивает throughput по сравнению с предыдущим, но практическая ценность определяется тем, как именно платформа использует эти линии.

Еще один источник путаницы — разница между скоростью передачи и полезной прикладной пропускной способностью. GT/s — это скорость сигнализации, а не готовые гигабайты в секунду, которые гарантированно получит приложение. Кроме того, PCIe — full duplex интерфейс: он способен передавать данные одновременно в обоих направлениях. Это важно для сетевых адаптеров, ускорителей и некоторых storage-сценариев, но в реальных задачах редко бывает так, что оба направления нагружены одинаково и непрерывно. Поэтому при оценке производительности всегда полезно уточнять, идет ли речь об одностороннем потоке, суммарной двусторонней емкости канала или о peak-значении из спецификации.

Нужно также помнить о согласовании по меньшему общему знаменателю. Устройство Gen5 в слоте Gen4 будет работать как Gen4. Устройство x8 в слоте x16 не станет внезапно x16. Более того, физический слот x16 может быть электрически подключен как x8, а иногда и делить линии с другим слотом, M.2-разъемом или backplane-узлом. Это одна из причин, почему формальный список слотов на плате почти никогда не дает полного понимания производительности без lane map и platform manual. В серверной среде это особенно критично, потому что именно там часто приходится балансировать между NIC, NVMe, GPU, DPU и RAID/HBA в пределах конечного числа CPU lanes.

PCIe Gen4 и Gen5: базовые цифры

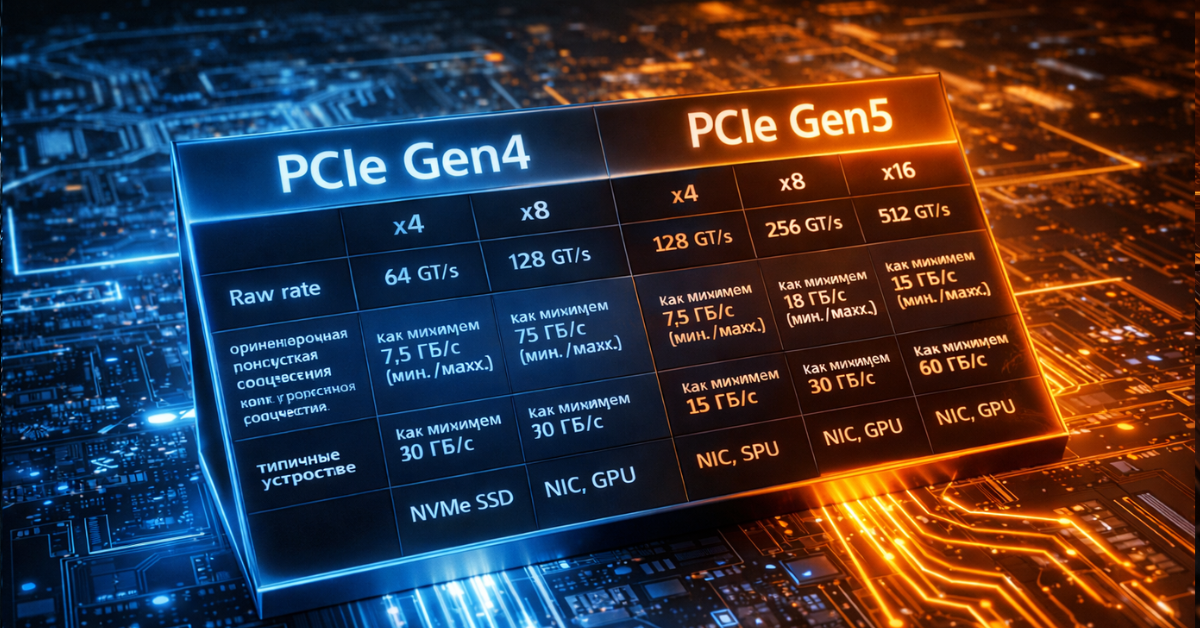

Ниже — практическая таблица, которая помогает быстро соотнести поколение, ширину и типичные сценарии использования. Значения полезной пропускной способности приведены ориентировочно, без ухода в низкоуровневые детали кодирования: для инженерной оценки этого достаточно.

| Конфигурация | Raw rate на линию | Ориентировочная полезная пропускная способность в одну сторону | Ориентировочная суммарная двусторонняя пропускная способность | Типичные устройства |

|---|---|---|---|---|

| PCIe 4.0 x4 | 16 GT/s | ~7,9 ГБ/с | ~15,8 ГБ/с | NVMe SSD |

| PCIe 4.0 x8 | 16 GT/s | ~15,8 ГБ/с | ~31,5 ГБ/с | NIC, ускорители, контроллеры |

| PCIe 4.0 x16 | 16 GT/s | ~31,5 ГБ/с | ~63 ГБ/с | GPU, высокоскоростные NIC |

| PCIe 5.0 x4 | 32 GT/s | ~15,8 ГБ/с | ~31,5 ГБ/с | Gen5 NVMe SSD |

| PCIe 5.0 x8 | 32 GT/s | ~31,5 ГБ/с | ~63 ГБ/с | NIC, DPU, ускорители |

| PCIe 5.0 x16 | 32 GT/s | ~63 ГБ/с | ~126 ГБ/с | GPU, AI/HPC-ускорители |

PCI-SIG фиксирует для PCIe 4.0 16,0 Гбит/с на линию в одном направлении и для PCIe 5.0 — 32,0 Гбит/с. Это и дает удвоение емкости канала между поколениями. На прикладном уровне из этой таблицы следуют два практических вывода. Первый: для обычного одиночного NVMe критичен именно x4-линк, и переход от Gen4 x4 к Gen5 x4 действительно поднимает потолок интерфейса примерно вдвое. Второй: для сетевых карт, GPU и ускорителей вопрос часто упирается уже не только в поколение, но и в необходимость x8 или x16 подключения без деградации по ширине.

Почему теоретическая пропускная способность почти никогда не равна реальной

У PCIe есть неприятная для любителей красивых цифр особенность: даже если линк поднялся в нужном режиме, это еще не означает, что приложение увидит сопоставимую скорость. Во-первых, есть protocol overhead. Во-вторых, есть характер нагрузки. Последовательный поток крупными блоками способен близко подойти к пределам интерфейса, а мелкоблочный random I/O может упереться в контроллер, очередь, CPU или память задолго до исчерпания пропускной способности шины. Для storage это особенно заметно: один и тот же SSD показывает совершенно разную картину на последовательном чтении, записи, mixed-профиле и latency-sensitive workload. PCI-SIG в материалах по NVMe и PCIe прямо связывает практическую ценность интерфейса не только с bandwidth, но и с latency, масштабированием по линиям и общей эффективностью платформы.

Во многих случаях bottleneck находится выше или ниже PCIe. Выше — это CPU, NUMA, память, файловая система, стек виртуализации, драйверы, сетевой стек, RAID/ZFS/Ceph-слой. Ниже — это контроллер устройства, флеш-память, внутренние очереди, thermal throttling, работа PHY и стабильность канала. Именно поэтому диск с маркетинговым обещанием «до 14 ГБ/с» не обязан выдавать такие цифры в приложении. Samsung для корпоративного PM1743 указывает PCIe 5.0 и позиционирует его как SSD для высокопроизводительных серверов; сам класс Gen5 SSD действительно подошел к границам интерфейса x4, но прикладной результат все равно зависит от платформы и нагрузки.

Еще один фактор — хвосты задержек. В enterprise-среде максимальная скорость почти никогда не является единственным критерием. Если p99 и p99.9 резко ухудшаются под смешанной нагрузкой, система может субъективно «не ехать», даже когда средний throughput выглядит достойно. Это особенно важно для storage nodes, баз данных, NVMe-oF targets, packet processing и AI-пайплайнов с чувствительностью к jitter. Поэтому PCIe bandwidth нужно рассматривать как необходимое, но далеко не достаточное условие высокой производительности. Без этого подхода очень легко перепутать красивый синтетический тест с реальной эффективностью платформы. (PCI-SIG)

Где PCIe ломается на уровне платформы

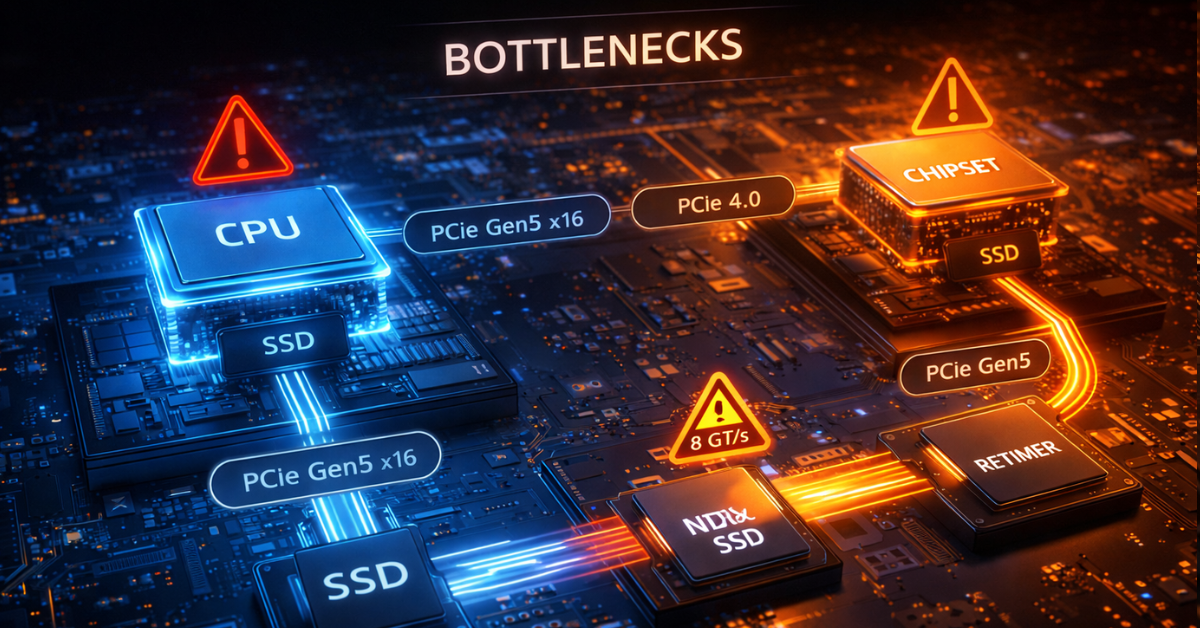

Недостаток линий CPU

Первое узкое место — банальная нехватка CPU lanes. Современная платформа может формально поддерживать Gen5, но число линий все равно конечно. Когда в один сервер одновременно пытаются уместить GPU, несколько NVMe-групп, высокоскоростной NIC, DPU и дополнительные контроллеры, начинается конкуренция за линии. Отсюда появляются конфигурации, где часть слотов работает только при отсутствии других устройств, где x16 превращается в x8/x8, а где-то включение еще одного накопителя лишает соседний слот полной ширины. Проблема не в том, что PCIe плох, а в том, что проектирование ввода-вывода всегда ограничено ресурсом CPU lanes и схемой разводки платформы.

Bifurcation в таких системах может быть и спасением, и компромиссом. С одной стороны, он позволяет превратить одну широкую группу линий в несколько независимых каналов, например x16 в 4×x4 для NVMe. С другой — это не увеличивает общее число линий и не отменяет необходимость правильно распределять устройства по сокетам и контроллерам. Если платформа задумывалась под одну карту x16, а ее принудительно разрезают под несколько накопителей и еще один NIC, риск столкнуться с неожиданной деградацией сильно растет.

Чипсетные линии против прямых CPU-линий

Второе крупное ограничение — разница между прямыми CPU lanes и линиями, висящими за чипсетом. Для конечного пользователя оба варианта могут выглядеть как «устройство подключено по PCIe», но архитектурно это не одно и то же. Устройство на CPU lanes получает более прямой доступ, а устройство за чипсетом делит uplink с остальной периферией. Пока речь идет о нетребовательном контроллере, boot SSD или умеренной периферии, это может быть приемлемо. Но если туда посадить интенсивный NVMe, быстрый NIC или latency-sensitive устройство, bottleneck может проявиться намного раньше, чем ожидалось.

На практике критичные к пропускной способности и задержкам устройства лучше планировать на CPU lanes. Чипсет хорош для периферии, которая не исчерпывает канал постоянно. Ошибка здесь особенно болезненна тем, что формально все может выглядеть корректно: линк поднимается, устройство работает, драйверы не ругаются, а производительность ниже ожидаемой и нестабильна под смешанной нагрузкой.

Физическая и электрическая ширина — не одно и то же

Одна из самых частых ошибок — вера в то, что физический слот x16 обязательно дает электрические x16. На серверных и даже рабочих платах это далеко не всегда так. Слот может быть x16 по форме, но x8 по подключению. Встречаются также схемы, где ширина зависит от заполнения соседних слотов. Похожая логика работает и с M.2, U.2, U.3, EDSFF: одинаково выглядящие варианты подключения могут иметь принципиально разную реальную полосу и разное происхождение линий.

Именно поэтому в инженерной работе мало посмотреть на фото платы или краткую спецификацию в магазине. Нужны lane map, block diagram, platform guide и понимание того, какие ресурсы делят между собой конкретные разъемы. Маркетинговая формулировка «есть слот x16» без уточнения происхождения линий и их распределения полезна примерно до первого реального теста.

Свитчи, ретаймеры и редрайверы

Переход к Gen5 делает гораздо более жесткими требования к целостности сигнала. PCI-SIG в своих материалах отдельно выделяет режим 32 GT/s как уровень, требующий более строгой валидации и комплаенса. На практике это означает, что длинные трассы, плотная компоновка, сложные backplane-сценарии и большое количество устройств становятся заметно чувствительнее к качеству канала. Отсюда растет роль ретаймеров, редрайверов и PCIe-свитчей.

Для пользователя это имеет несколько последствий. Во-первых, Gen5-платформа почти неизбежно сложнее и дороже в реализации. Во-вторых, дополнительные элементы канала — это не только удобство масштабирования, но и дополнительные требования к совместимости, питанию, охлаждению и прошивкам. В-третьих, нестабильность линка на высоких скоростях может проявляться не как очевидная ошибка, а как неидеальная производительность, сброс скорости, нестабильное поведение под нагрузкой и сложность в воспроизводимости результатов.

NUMA и размещение устройств

В двухсокетных системах вопрос «в какой слот вставить устройство» часто оказывается важнее, чем спор Gen4 против Gen5. Если NIC, NVMe-группа или ускоритель физически привязаны к одному сокету, а основная вычислительная нагрузка и память живут на другом, трафик начинает ходить через межсокетную связь. В таком случае реальный ущерб от неудачной NUMA-локальности может оказаться больше, чем выигрыш от перехода на более новое поколение PCIe.

Именно поэтому для высоконагруженных серверов важно учитывать affinity, pinning, размещение потоков, локальность памяти и соответствие слота нужному сокету. Нередко корректная привязка устройства и workload дает больший эффект, чем апгрейд с Gen4 на Gen5 без изменения топологии.

Узкие места по типам устройств

NVMe SSD

Именно SSD первыми показали, что Gen5 способен не просто существовать на бумаге, а реально менять класс производительности интерфейса x4. Корпоративные Gen5 SSD уже работают в диапазоне, близком к пределу такого линка: Samsung PM1743 официально относится к PCIe 5.0 семейству и позиционируется как high-performance enterprise SSD. Это означает, что для быстрых накопителей вопрос интерфейса уже не теоретический. Gen4 x4 действительно может стать потолком в последовательных сценариях, а Gen5 x4 — открыть пространство для дальнейшего роста.

Но именно с SSD особенно важно не попасть в ловушку линейного мышления. Если workload мелкоблочный, latency-sensitive, упирается в CPU, файловую систему, RAID/ZFS/Ceph, контроллер или thermal throttling, прирост от Gen5 будет намного меньше ожидаемого. Более того, Gen5 SSD обычно горячее и требовательнее к охлаждению. Поэтому для одиночного boot/app drive или умеренной корпоративной нагрузки Gen4 часто остается рациональным выбором, тогда как плотные массивы быстрых NVMe, стриминг больших данных, scratch-space для AI и тяжелые storage-сценарии уже начинают раскрывать пользу Gen5.

Сетевые карты

Для сетевых карт оценка должна начинаться не с скорости порта, а с реального характера трафика. 25/50/100GbE нередко хорошо чувствуют себя на Gen4, особенно если нагрузка не экстремальна по packet rate, а платформа правильно спроектирована. Но по мере перехода к 200/400GbE, SmartNIC и DPU вопрос host interface становится намного острее. Intel для E810-XXVDA4 прямо указывает PCIe 4.0, 16 GT/s и x16 lanes, что уже хорошо показывает: даже 25GbE-класс в высокой портовой плотности требует серьезного host-side канала, если задача — не просто “поднять линк”, а стабильно обслуживать нагруженные cloud- и communications-сценарии.

На верхнем конце шкалы это видно еще отчетливее. NVIDIA ConnectX-7 позиционируется как адаптер класса до 400Gb/s, рассчитанный на современные cloud, AI и enterprise workloads. Для такого уровня сетевой пропускной способности вопрос PCIe перестает быть второстепенным: здесь важны и ширина, и поколение, и NUMA, и offload-возможности, и DMA-поведение, и то, насколько быстро CPU успевает обслуживать поток. Платформа может формально поддерживать нужный адаптер, но без правильной топологии сервер не реализует весь смысл такого NIC.

GPU и AI-ускорители

С ускорителями ситуация сложнее, чем с SSD или NIC. Сам факт наличия PCIe Gen5 x16 не означает, что узкое место автоматически исчезает. AMD для Instinct MI300X указывает PCIe 5.0 x16 как bus type, но рядом с этим фигурируют и Infinity Fabric links, и огромная собственная память, и колоссальная внутренняя bandwidth подсистемы памяти. Это хороший пример того, что в AI/HPC производительность ускорителя определяется не только host link, но и архитектурой памяти, межускорительными интерконнектами и характером обмена данными между CPU и accelerator.

Для inference, где модель или ее рабочая часть уже размещена на ускорителе, роль host link может быть умеренной. Для training, data staging, многоускорительных конфигураций, стриминга данных, GPUDirect-подобных сценариев и тесной работы с быстрым storage или networking PCIe начинает играть намного более заметную роль. Но даже тогда Gen5 — это не универсальный ответ. Неправильная NUMA-привязка, дефицит линий, конфликт за ресурсы между NIC и GPU, а также топология межускорительных связей могут съесть эффект быстрее, чем сама версия шины успеет его дать.

Самые частые ошибки при выборе PCIe

Ниже — ошибки, которые чаще всего приводят к разочарованию даже в дорогих конфигурациях.

Смотреть только на поколение и игнорировать ширину. Gen5 x4 и Gen4 x8 — это не одно и то же, но и не пропасть между мирами. Всегда считайте поколение вместе с количеством линий.

Думать, что любой x16 физически равен x16 электрически. Без проверки block diagram это предположение опасно.

Не учитывать лимит CPU lanes. Устройство может работать, но соседний слот или группа накопителей из-за него потеряют ширину.

Не различать CPU lanes и chipset lanes. Для критичных устройств эта разница способна полностью изменить итоговую картину.

Забывать про NUMA. Неправильный слот иногда режет производительность сильнее, чем разница между Gen4 и Gen5.

Ожидать линейного удвоения прикладной производительности. Удваивается емкость интерфейса, а не обязательно скорость приложения.

Оценивать SSD только по последовательному чтению. Для большинства корпоративных нагрузок этого недостаточно.

Не учитывать охлаждение Gen5 SSD и NIC. Рост производительности почти всегда приносит и рост тепловой плотности.

Не проверять lane sharing на конкретной плате. Особенно опасно в системах с несколькими M.2, OCP, U.2/U.3 и дополнительными слотами.

Игнорировать программный стек. Часто узкое место сидит не в PCIe, а в драйверах, гипервизоре, файловой системе или сетевой обработке.

Как понять, что bottleneck действительно в PCIe

Диагностика должна начинаться не с апгрейда железа, а с проверки фактов. Если устройство работает медленнее ожидаемого, прежде всего нужно посмотреть negotiated speed и width. В практической эксплуатации это часто позволяет сразу отсеять банальные проблемы: карта поднялась как x8 вместо x16, Gen5 SSD по какой-то причине работает как Gen4, а устройство сидит не там, где предполагалось. Для современных GPU-, NIC- и storage-конфигураций AMD в своей документации по кластерным системам прямо рекомендует заранее собирать PCIe-адреса устройств и проверять, что адаптеры и внутренние свитчи используют максимальную доступную скорость и ширину.

После этого нужно сверить топологию. Важно понять, где сидит устройство — на CPU lanes или за чипсетом, к какому сокету оно привязано, не делит ли линии с другим слотом или портом, и нет ли проблем с NUMA locality. Затем проверяются thermals: быстрый Gen5 SSD или NIC под недостаточным охлаждением может троттлить так, что картинка будет напоминать «плохой PCIe», хотя реальная причина совсем в другом.

Следующий шаг — отделить PCIe bottleneck от ограничений CPU, памяти, накопителя и программного стека. Если throughput низкий, а CPU загружен, проблема может быть в обработке прерываний, очередях, сетевом стеке или коде приложения. Если пропускная способность выглядит неплохо, но p99-поведение плохое, виновником может быть не интерфейс, а scheduling, contention, файловая система, RAID-слой или GC/буферизация на уровне приложения. Поэтому synthetic и production-like тесты обязательно нужно сопоставлять: первый показывает предел железа, второй — поведение системы в реальном профиле.

Практический чек-лист выглядит так:

Проверить negotiated speed и negotiated width.

Определить, подключено ли устройство к CPU lanes или через чипсет.

Проверить NUMA-локальность относительно CPU, памяти и workload.

Исключить thermal throttling.

Проверить lane sharing со слотами, OCP, M.2 и накопительными корзинами.

Оценить, не упирается ли задача в драйверы, файловую систему, сетевой стек или гипервизор.

Сравнить синтетические тесты с производственным профилем нагрузки.

Когда Gen4 достаточно, а когда Gen5 действительно нужен

Самая дорогая ошибка — взять Gen5 «на всякий случай», не понимая, раскроется ли он в вашей задаче. Для типичной виртуализации, умеренных корпоративных workloads, большинства 25/50/100GbE-сценариев и одиночных либо неэкстремальных NVMe-подсистем Gen4 часто остается абсолютно рациональным выбором. Он зрелый, предсказуемый, обычно проще по теплу и валидации, а выигрыш от перехода на Gen5 может остаться в пределах красивых тестов, но не реального продакшена.

Gen5 оправдан там, где действительно есть потребность в более высокой I/O-плотности на линию. Это быстрые Gen5 NVMe-массивы, 200/400GbE и современные SmartNIC/DPU, accelerator-heavy AI/HPC-серверы, системы, где важно уменьшить число занятых линий и слотов при сохранении throughput на устройство, а также платформы с понятным горизонтом роста. Иными словами, Gen5 нужен не потому, что он новее, а потому что он позволяет снять конкретное ограничение в конкретной архитектуре.

Ниже — прикладная сводка по типовым сценариям.

| Сценарий | Что чаще всего становится bottleneck | Когда хватает Gen4 | Когда нужен Gen5 |

|---|---|---|---|

| Одиночный NVMe boot/app SSD | Контроллер, workload, файловая система, CPU | Почти всегда | Редко, если это не очень быстрый data drive |

| Массив быстрых NVMe | Линии CPU, охлаждение, PCIe-свитчи, storage stack | Если массив умеренный и не выходит на предел интерфейса | Когда нужна высокая плотность и максимальный throughput на x4/x8-канал |

| 100GbE storage node | NUMA, CPU, DMA, storage stack | Часто хватает | При агрессивной packet processing и высокой плотности I/O |

| 200/400GbE network appliance | Host interface, CPU, NUMA, offload | Уже на грани или недостаточно | Часто оправдан |

| GPU/AI сервер | Топология, межускорительные связи, NUMA, host link | Для части inference-сценариев | Для тяжелых accelerator-heavy конфигураций |

| Универсальный virtualization host | CPU, память, storage stack, oversubscription | Обычно хватает | Когда платформа одновременно несет очень плотный I/O |

Практические рекомендации по проектированию сервера или рабочей станции

Правильный порядок действий почти всегда один и тот же. Сначала считается workload, потом выбирается поколение PCIe. Не наоборот. Если нет понимания профиля нагрузки, размера блоков, packet rate, роли latency и топологии потоков данных, обсуждение Gen4 против Gen5 быстро превращается в спор о наклейках на коробке.

Дальше нужно проверять lane map платформы. Для критичных устройств стоит заранее определить, какие слоты висят на CPU lanes, какие делят ресурсы, какие завязаны на конкретный сокет и как меняется схема при установке дополнительных карт или накопителей. NIC, быстрые NVMe-группы, DPU и ускорители лучше сажать туда, где минимален риск лишних переходов и конкуренции за uplink.

NUMA нельзя оставлять на потом. Если устройство интенсивно работает с конкретным пулом памяти или набором ядер, его размещение должно этому соответствовать. В двухсокетных системах без этого очень легко получить сервер, который «по паспорту» идеален, а по факту постоянно гоняет данные через межсокетную связь.

Bifurcation и расширяемость лучше планировать заранее. Особенно если речь идет о платформах, где сегодня нужен один NIC и несколько SSD, а завтра добавятся еще два накопителя, DPU или ускоритель. Запас по топологии и охлаждению важнее, чем мнимая экономия на старте. Для Gen5 это особенно актуально: более высокая скорость обычно означает и более высокую чувствительность к теплу, качеству сигнала и платформенной валидации.

И наконец, мыслить нужно системно. Версию PCIe нельзя анализировать отдельно от ширины, происхождения линий, NUMA, программного стека и типа нагрузки. «Есть слот Gen5» и «устройство реально и стабильно работает как Gen5 xN под моей нагрузкой» — это разные утверждения. Между ними лежит вся серверная инженерия.

Вывод

PCIe Gen5 — это не магическая кнопка ускорения и не автоматический рецепт для любой новой системы. Это следующий уровень пропускной способности, который действительно нужен части современных серверных конфигураций, но раскрывается только в правильно спроектированной платформе. Во многих случаях узкое место находится не в самом поколении PCIe, а в числе линий, электрической ширине слота, топологии, NUMA, чипсетном uplink, охлаждении, прошивках и профиле нагрузки.

Поэтому правильный вопрос звучит не «стоит ли брать Gen5», а «какое именно ограничение моей системы Gen5 снимает». Если ответа на этот вопрос нет, Gen4 нередко остается более зрелым и рациональным выбором. Если ответ есть и он упирается в плотность I/O, быстрые NVMe, 200/400GbE, DPU или accelerator-heavy среду, тогда Gen5 перестает быть модным словом и становится инженерно оправданным решением.

Источники: PCI-SIG, PCI-SIG FAQ, Intel, Samsung PM1743, Intel E810.

Нажимая кнопку «Отправить», я даю согласие на обработку и хранение персональных данных и принимаю соглашение