В карточке SSD у поставщика обычно видны интерфейс, объём и пиковые цифры скоростей вроде «до 7 ГБ/с» или «до 1 млн IOPS». Для сервера этого мало. На практике накопитель выбирают не по тому, как он выглядит в коротком бенчмарке, а по тому, что происходит с записью до её фиксации в NAND, как диск переживает внезапную потерю питания и насколько предсказуемы его задержки под длительной смешанной нагрузкой. Именно поэтому write cache, PLP и QoS нужно рассматривать вместе, а не по отдельности. NVMe давно стал массовым, но разница между client- и data center-SSD никуда не делась: она проявляется не в красивом старте теста, а в flush, mixed workload, steady state и power event.

Что такое write cache в SSD и почему он не равен «безопасной записи»

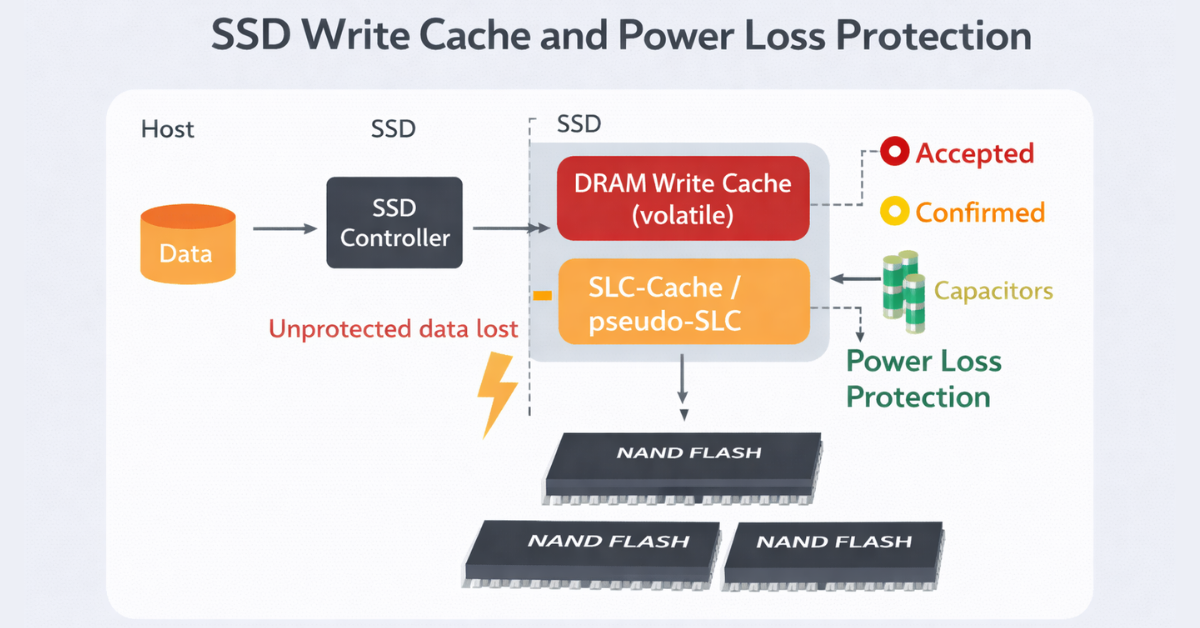

Write cache — это буферизация записи перед окончательным размещением данных в энергонезависимой памяти. На практике под «быстрой записью SSD» могут скрываться сразу несколько механизмов: буферизация в контроллере, DRAM для mapping-таблиц и метаданных, SLC-cache или pseudo-SLC, а также логика FTL, которая перераспределяет реальные физические записи. Пользователь видит итоговую скорость, но не видит главное: в какой момент данные действительно стали энергонезависимыми. NVMe отдельно описывает volatile write cache и команду Flush, которая нужна, чтобы гарантировать сброс данных из volatile-части на стабильный носитель.

Здесь важно различать четыре разных состояния:

- данные приняты SSD;

- приём данные подтверждён;

- данные записаны в NAND;

- данные защищены от внезапной потери питания.

Это не одно и то же. Накопитель может быстро подтвердить запись, потому что принял её в кэш, но это ещё не означает, что при потере питания запись переживёт отключение. Поэтому write cache сам по себе не плох: проблема начинается там, где кэш volatile, SSD рано подтверждает запись, а стек выше — ОС, RAID, гипервизор или СУБД — рассчитывает на более сильные гарантии долговечности. Microsoft отдельно подчёркивает значение write-through/FUA для durable writes: приложение может требовать, чтобы запись считалась завершённой только после попадания на стабильный носитель, а не просто после прохождения промежуточного кэша.

Что может скрываться за высокой скоростью записи SSD:

- SLC-буфер, который быстро заканчивается на длинной записи;

- агрессивное кэширование с ранним подтверждением записи;

- низкая реальная sustained write после выхода из burst-режима;

- сильная зависимость от свободного места;

- просадка из-за температуры, garbage collection и фоновых операций FTL.

Отсюда главный практический вывод: быстрый burst и надёжная commit-операция — разные вещи. DRAM и SLC-cache могут заметно улучшать отзывчивость, но сами по себе не дают гарантий сохранности подтверждённой записи.

PLP: что именно он защищает и почему формулировка «есть защита от потери питания» бывает обманчивой

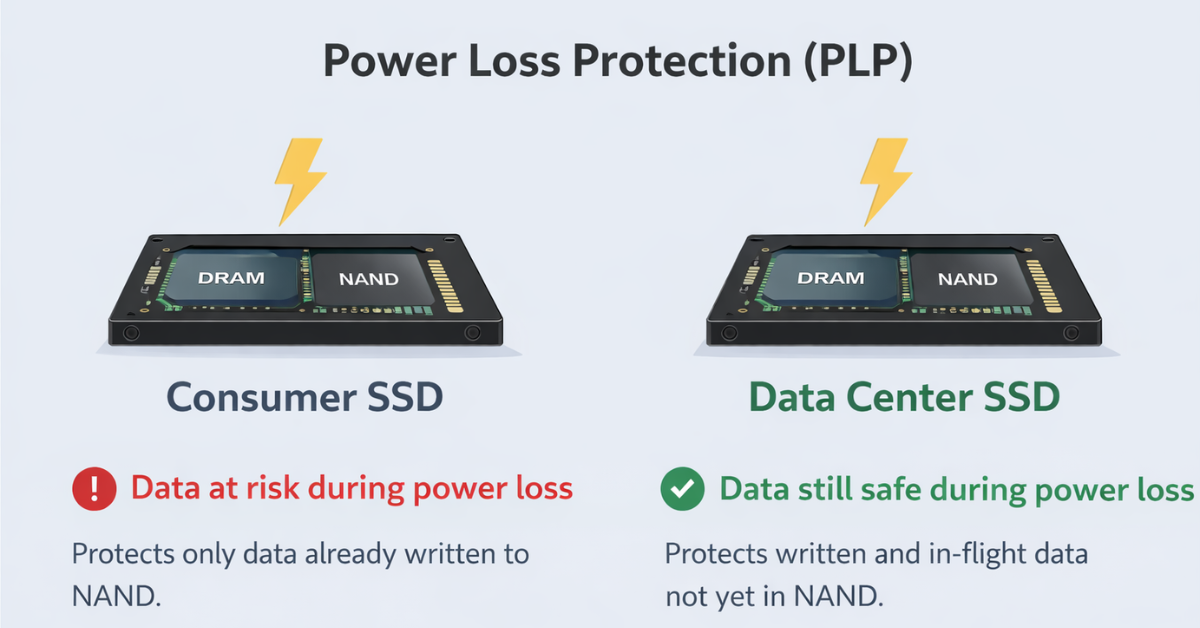

PLP, или Power Loss Protection, — это механизм защиты SSD при внезапном отключении питания. Но здесь есть принципиально важное различие между data at rest и data in flight. Data at rest — это данные, уже записанные в энергонезависимую память. Data in flight — это данные, которые уже прошли часть пути, могли быть подтверждены хосту, но ещё не успели полностью и безопасно лечь в NAND.

Именно здесь проходит реальная граница между многими consumer/client- и полноценными data center-SSD. Micron прямо показывает, что client-уровень защиты часто ориентирован прежде всего на уже записанные данные, тогда как датацентровый PLP проектируется так, чтобы довести до безопасного состояния ещё и подтверждённые, но не завершённые записи. Иначе говоря, наличие элементов защиты на плате ещё не означает одинаковый уровень гарантий.

| Тип защиты | Что сохраняет | Что не гарантирует | Где обычно встречается | Подходит ли для production write-heavy |

|---|---|---|---|---|

| Нет заявленной защиты | Только то, что уже успело безопасно записаться | Сохранность кэша, mapping, подтверждённых in-flight writes | Бюджетные consumer SSD | Нет |

| Data-at-rest protection | Уже записанные данные в NAND | Сохранность подтверждённых, но не завершённых записей | Client/prosumer модели | Ограниченно |

| Частичная power-loss handling | Часть служебных данных и часть незавершённых операций | Полные гарантии для committed writes | Переходные модели | Скорее как компромисс |

| Полноценный enterprise PLP | Данные at rest и данные in flight в пределах заявленной модели | Не отменяет требований к стеку выше и корректным flush/FUA | Data center SSD | Да |

Поэтому формулировки вроде «power-loss management», «power-loss signal support» или даже «data-at-rest protection» нельзя автоматически считать эквивалентом enterprise PLP. Для boot-диска или read-mostly сценария это ещё может быть разумным компромиссом. Но для WAL, redo, transaction log, metadata-heavy storage, write-back RAID, ZFS intent log, Ceph-журналирования и похожих задач отсутствие полноценного PLP — уже архитектурный риск, а не мелкая недостача в спецификации.

QoS SSD: почему это не маркетинг, а реальная метрика для серверных нагрузок

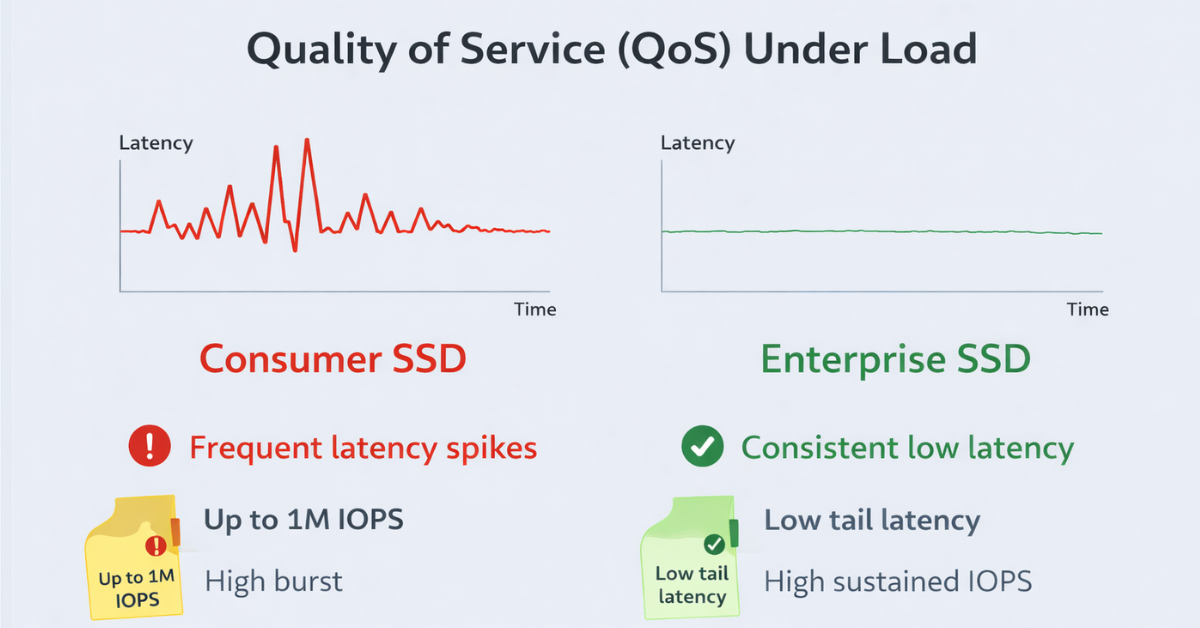

В контексте SSD QoS — это не абстрактное «качество сервиса», а предсказуемость задержек. Важнее всего здесь не average latency, а high percentile latency: 99%, 99.9%, 99.99%, 99.999%. Именно эти цифры показывают, насколько часто накопитель выдаёт редкие, но очень длинные провалы — tail latency.

Для production это критично. База данных, гипервизор или узел хранения чаще страдают не от того, что средняя задержка выросла с 80 до 110 микросекунд, а от того, что редкие операции внезапно начинают занимать миллисекунды именно в момент нагрузки. KIOXIA, например, выносит в материалы по датацентровым NVMe не только пиковые IOPS, но и 99.999-й процентиль задержки в реальных сценариях, включая смешанную OLTP-подобную нагрузку. Это хороший признак зрелого продукта: производитель показывает не только максимум, но и насколько диск предсказуем на длинной дистанции.

Почему QoS ломается:

- garbage collection и перенос данных внутри SSD;

- заполнение накопителя и сокращение свободного пула блоков;

- исчерпание SLC-cache;

- thermal throttling;

- mixed read/write нагрузка вместо «лабораторных» 100% read;

- фоновые операции FTL;

- конкуренция потоков и шумные соседи в виртуализированной среде.

На что смотреть в спецификации и тестах:

- percentile latency, а не только average latency;

- steady state, а не только burst;

- mixed workload, а не один режим 100% read;

- QD1/QD4 и реалистичные глубины очереди;

- поведение после заполнения;

- consistency under sustained load.

Высокие IOPS без хорошего QoS могут оказаться бесполезны в production. SSD красиво проходит короткий synthetic benchmark, но при длительной рабочей нагрузке начинает давать хвостовые задержки, которые бьют по транзакциям, репликации и общей отзывчивости сервиса.

Как write cache, PLP и QoS связаны между собой

Эти три вещи нельзя оценивать по отдельности.

- Write cache отвечает за то, как накопитель ускоряет запись.

- PLP отвечает за то, можно ли доверять подтверждённой записи при потере питания.

- QoS отвечает за то, насколько предсказуемо всё это работает под реальной нагрузкой.

Отсюда простая схема:

- Быстро не равно надёжно.

- Надёжно не равно стабильно по задержкам.

- Стабильно в burst не равно стабильно в steady state.

- Наличие NVMe не равно enterprise-grade поведению.

Агрессивный write cache может резко улучшить мгновенные метрики. Но если у накопителя нет полноценного PLP, эта модель становится рискованной там, где приложение рассчитывает на durable write. А если у SSD слабый QoS, то даже при формальной надёжности запись начнёт вести себя неровно: не ломаться, но «пилить» хвостовыми задержками всю систему.

Где ошибки выбора SSD встречаются чаще всего

SSD для БД и журналов

WAL, redo log и transaction log чувствительны именно к подтверждённой записи и хвостовым задержкам. Здесь важны и PLP, и низкий tail latency. Красивые пиковые IOPS сами по себе мало значат, если commit иногда уходит в миллисекунды или запись подтверждается раньше, чем реально становится безопасной.

SSD для виртуализации

У виртуализации смешанная нагрузка, много мелкого IO и конкуренция соседей. Средняя производительность может выглядеть прилично, но слабый QoS быстро проявляется как «рандомные тормоза» отдельных ВМ. Поэтому для VM storage предсказуемость почти всегда ценнее пикового результата в одном бенчмарке.

SSD для Ceph, SDS и storage nodes

Репликация не отменяет локальных требований к накопителю. Один SSD с плохим tail latency может ухудшать время отклика всего кластера, особенно на фоне recovery, rebalance и смешанных потоков чтения-записи. Здесь ошибочно думать, что «кластер всё сгладит».

SSD для RAID и ZFS

Здесь вопрос не только в скорости, но и в согласованности гарантий записи. Нельзя автоматически переносить домашний опыт с consumer NVMe в production-массив. Если стек хранения рассчитывает на корректное поведение flush/FUA, а накопитель силён только в burst-показателях, проблема проявится в самые неприятные моменты — при деградации, rebuild и интенсивной фоновой работе.

SSD под boot, read-mostly и холодные данные

Именно здесь компромисс возможен чаще всего. Но и здесь серверный boot SSD — не всегда просто «любой дешёвый consumer-диск». Нужны хотя бы понятные ограничения по нагрузке, температуре и ожидаемому профилю записи.

Какие маркетинговые формулировки особенно часто вводят в заблуждение

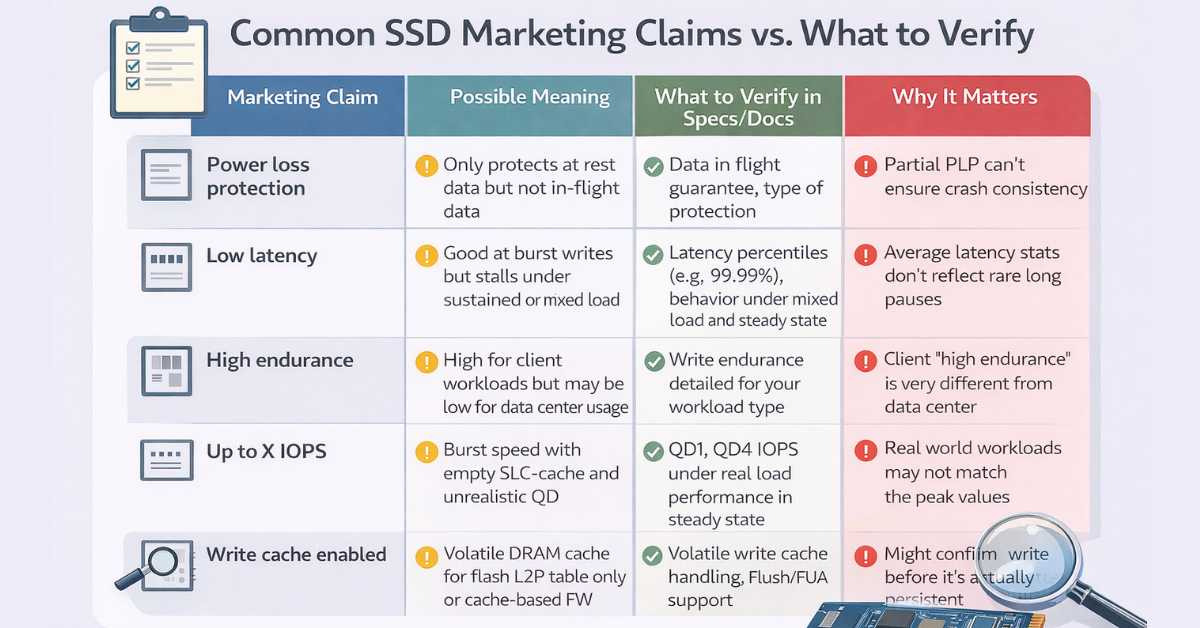

Самые частые ошибки чтения спецификации просты: DRAM принимают за PLP, SLC-cache — за стабильную sustained write, а высокие IOPS — за гарантию хорошего QoS.

Как правильно выбирать SSD, если важны не только скорость, но и надёжность записи

Практический чек-лист:

- Уточнить, есть ли полноценный PLP, а не расплывчатая защита от power loss.

- Проверить, говорится ли прямо о защите data in flight, а не только data at rest.

- Смотреть, публикует ли производитель latency percentile и QoS-метрики.

- Ищет ли документация данные по steady state, а не только по свежему пустому диску.

- Есть ли результаты на mixed workload, а не только на 100% read.

- Понимать класс устройства: client, prosumer, read-intensive data center, mixed-use, write-intensive.

- Учитывать размер и поведение SLC-cache.

- Проверять риск thermal throttling в реальном серверном корпусе.

- Смотреть, как меняется производительность при заполнении.

- Закладывать свободное место и overprovisioning там, где важна консистентность.

Когда можно идти на компромисс, а когда лучше не экономить

Экономия может быть оправдана в lab, dev/test, read-mostly сценариях, в backup-репозиториях с низкой чувствительностью к latency и иногда в роли загрузочного диска при понятных ограничениях.

Экономить опасно там, где для приложения важны durable writes и предсказуемая латентность: OLTP, VM storage, Ceph/SDS, metadata-intensive storage, write-heavy RAID/ZFS и любые критичные системы, где потеря подтверждённой записи или длинные хвостовые задержки недопустимы.

Не каждый сервер требует самых дорогих SSD. Но непонимание write path и гарантий записи обычно обходится дороже, чем разница в цене между «быстрым на бумаге» и действительно подходящим накопителем.

Вывод

Выбирать SSD только по интерфейсу и пиковым цифрам — ошибка. Для серверных сценариев нужно смотреть сразу на три вещи: как диск ускоряет запись, что произойдёт при потере питания и насколько предсказуемы задержки под реальной нагрузкой.

Формула здесь простая: write cache отвечает за модель ускорения записи, PLP — за доверие к подтверждённой записи, QoS — за предсказуемость работы системы в реальности. Именно поэтому два SSD с похожими скоростями в спецификации могут вести себя в сервере совершенно по-разному.

Источники: NVMe Base Specification, Micron: Client vs. Data Center SSDs, Micron: How SSDs Handle Unexpected Power Loss, KIOXIA on data center latency/QoS, Microsoft SQL Server storage guide.

Нажимая кнопку «Отправить», я даю согласие на обработку и хранение персональных данных и принимаю соглашение