Для большинства корпоративных задач не обязательно начинать с топовых ускорителей вроде H100 или H200: внутренний чат-бот, поиск по документам, компьютерное зрение, рендеринг, виртуальные рабочие станции и умеренный инференс часто закрываются более простыми вариантами, такими как L40S, A30 или RTX Pro. H100/H200 нужны там, где ограничением становятся не просто вычисления, а объем и скорость видеопамяти, обучение крупных моделей, высокая параллельность, длинный контекст, тяжелые расчеты или сервис с жесткими требованиями к задержке. Главная ошибка — выбирать GPU по статусу, а не по задаче, памяти, корпусу, питанию, охлаждению и стоимости владения.

Почему самый дорогой GPU не всегда лучший выбор

GPU-сервер выбирают не так, как обычный рабочий компьютер. В нем важна не только видеокарта, а вся платформа: корпус, процессоры, оперативная память, линии PCIe, диски, сеть, блоки питания, стойка, воздушный поток и возможность обслуживания. Если один из этих элементов не соответствует нагрузке, дорогой ускоритель может работать хуже, чем более простая карта в правильно подобранной системе.

Покупка H100 или H200 «на всякий случай» часто выглядит безопасным решением, но на практике может привести к лишним расходам. Старшие ускорители требуют подходящей серверной платформы, мощного питания, правильного охлаждения и нормальной утилизации. Если компания запускает небольшой внутренний сервис, который отвечает на вопросы сотрудников несколько раз в час, такой сервер большую часть времени будет простаивать.

Обратная ошибка — пытаться сэкономить там, где нагрузка действительно тяжелая. Если модель не помещается в видеопамять, пользователи ждут ответы слишком долго, а сервер постоянно работает на пределе, более доступная карта не станет выгодной. Она просто перенесет проблему в очередь запросов, ограничения по контексту, падение скорости и рост затрат на администрирование.

Правильный выбор начинается не с вопроса «какая GPU лучше», а с вопроса «что именно будет делать сервер». Для рендеринга важна графика. Для больших языковых моделей — видеопамять и кэш. Для обучения — скорость памяти, связь между ускорителями и стабильная длительная нагрузка. Для виртуальных рабочих станций — разделение ресурсов, драйверы и предсказуемость на пользователя. Поэтому универсального ответа «берите H100» или «берите L40S» не существует.

Какие GPU сравниваем

A30, L40S, RTX Pro, H100 и H200 нельзя рассматривать как одну линейку, где каждая следующая карта просто «лучше». Это разные классы ускорителей.

A30 — серверная карта предыдущего поколения, которая все еще может быть полезна для умеренного инференса, корпоративных сервисов, виртуализации графики и задач, где важны энергоэффективность и разделение ресурсов. У A30 24 ГБ памяти HBM2, пропускная способность 933 ГБ/с, подключение PCIe четвертого поколения, тепловой пакет 165 Вт и возможность разделения на несколько изолированных экземпляров для разных пользователей или задач. Для крупных языковых моделей этого уже часто мало, но для многих прикладных сценариев карта остается рабочей.

L40S — более универсальный вариант. NVIDIA описывает ее как ускоритель для дата-центровых задач, где совмещаются искусственный интеллект, графика, рендеринг, видео, обучение и инференс больших языковых моделей. У L40S 48 ГБ памяти и тепловой пакет 350 Вт, поэтому она заметно сильнее A30 в смешанных сценариях, но при этом не относится к тому же классу, что H100/H200.

RTX Pro — не одна конкретная карта, а семейство профессиональных ускорителей. Если говорить о современном серверном ориентире, логично рассматривать RTX PRO 6000 Blackwell Server Edition. Это карта для смешанных нагрузок: искусственный интеллект, визуализация, 3D-графика, видео, инженерные приложения, виртуальные рабочие станции. У нее 96 ГБ GDDR7 с коррекцией ошибок, пропускная способность памяти 1597 ГБ/с и настраиваемое потребление до 600 Вт. Большой объем памяти делает ее интересной там, где 48 ГБ уже тесно, но H100/H200 экономически не всегда оправданы.

H100 и H200 — старший класс для тяжелого искусственного интеллекта и высокопроизводительных расчетов. H100 в вариантах SXM и NVL имеет 80–94 ГБ памяти и пропускную способность 3,35–3,9 ТБ/с. H200 идет дальше: 141 ГБ памяти HBM3e и 4,8 ТБ/с пропускной способности. Это важно для крупных моделей, длинного контекста, высокой параллельности, обучения и задач, где скорость обмена с памятью становится главным ограничением.

Главный критерий — задача, а не название GPU

Одна и та же карта может быть хорошей покупкой для одного отдела и ошибкой для другого. Поэтому сравнивать GPU нужно по сценариям.

Для инференса больших языковых моделей важны размер модели, точность хранения весов, длина контекста, число одновременных пользователей, кэш запросов, скорость первого ответа и общий темп генерации. Небольшая модель для внутреннего помощника может уверенно работать на L40S или RTX Pro. Но крупная модель с длинным контекстом и десятками параллельных пользователей быстро упирается в память и ее пропускную способность. Здесь H100/H200 могут быть не роскошью, а способом получить стабильную задержку.

Для компьютерного зрения важны другие параметры: разрешение изображений, количество видеопотоков, декодирование видео, пакетная обработка и задержка. Распознавание объектов, классификация изображений, обработка документов, контроль качества на производстве и видеоаналитика часто не требуют H100/H200. В таких задачах A30, L40S или RTX Pro могут быть рациональнее, особенно если нагрузка умеренная или совмещается с графикой.

Для рендеринга и 3D-графики старшие AI-карты не всегда лучший выбор. Здесь важны графические ядра, трассировка лучей, поддержка профессиональных приложений, видеокодирование, драйверы и стабильность визуальных рабочих процессов. В таких сценариях RTX Pro и L40S обычно выглядят логичнее, чем H100/H200. H100 может быть мощной вычислительной картой, но это не делает ее подходящей для профессиональной графической станции.

Для обучения и дообучения моделей нужно смотреть на масштаб. Небольшие эксперименты, дообучение адаптеров, тестирование архитектур и прикладные задачи могут выполняться на L40S или RTX Pro. Но если компания обучает крупные модели, проводит много экспериментов, работает с большими наборами данных и считает время обучения критичным, экономия на классе GPU быстро становится сомнительной. В таких случаях H100/H200 дают преимущество не только по вычислениям, но и по памяти, пропускной способности и масштабированию.

Для виртуальных рабочих станций важны не рекордные показатели, а управляемость. Пользователи подключаются к рабочей среде на сервере и работают с инженерными, графическими, аналитическими или производственными приложениями. Здесь нужны подходящие драйверы, разделение ресурсов, стабильность, память на пользователя и предсказуемая графическая производительность. A30, L40S и RTX Pro часто лучше подходят для таких задач, чем H100/H200.

Для смешанных нагрузок выбор становится сложнее. Например, днем сервер обслуживает виртуальные рабочие станции, вечером обрабатывает видео, ночью запускает инференс или дообучение. В такой ситуации L40S и RTX Pro часто дают лучший баланс, потому что закрывают и вычисления, и графику. H100/H200 лучше выбирать для выделенного AI-сервера или кластера, где большую часть времени идет тяжелая вычислительная нагрузка.

Какой GPU под какую задачу

| Задача | Когда хватит A30 | Когда хватит L40S | Когда хватит RTX Pro | Когда нужен H100/H200 |

|---|---|---|---|---|

| Инференс языковых моделей | небольшие модели, умеренная параллельность | внутренний чат-бот, поиск по документам, средние модели | модели и сервисы, которым нужен большой запас памяти | крупные модели, длинный контекст, много пользователей |

| Компьютерное зрение | классификация, простая аналитика, обработка документов | видеоаналитика, несколько потоков, смешанные AI-задачи | зрение плюс графика, видео и рабочие станции | массовая обработка или совмещение с тяжелыми моделями |

| Рендеринг и 3D | ограниченно, для простых задач | хорошо для серверной графики и визуализации | часто самый логичный вариант | обычно не лучший выбор |

| Обучение и дообучение | только небольшие эксперименты | дообучение и средние задачи | дообучение плюс визуальные нагрузки | тяжелое обучение и крупные модели |

| Виртуальные рабочие станции | хорошо при умеренных требованиях | хорошо для плотных конфигураций | хорошо для профессиональных рабочих мест | чаще избыточно |

| Смешанные нагрузки | базовый уровень | сильный универсальный вариант | универсальный вариант с большим запасом памяти | если AI-нагрузка доминирует |

Эта таблица не заменяет расчет, но помогает не начинать выбор с неверного класса. Если основная задача — рендеринг и рабочие места инженеров, H100/H200 могут быть лишними. Если задача — большая модель, длинный контекст и постоянная высокая нагрузка, A30 или L40S могут оказаться слишком ограниченными.

Когда A30 все еще имеет смысл

A30 не стоит списывать только потому, что появились более новые карты. Это ускоритель для своего класса задач. Он может быть разумным выбором, если компании нужен не максимальный темп генерации больших моделей, а стабильный корпоративный сервер для умеренного инференса, обработки данных, виртуальных рабочих станций или нескольких небольших сервисов.

24 ГБ видеопамяти — это уже ограничение для современных крупных языковых моделей. Но для классификации обращений, распознавания изображений, извлечения данных из документов, работы небольших языковых моделей, пакетной аналитики и виртуальных рабочих мест этого может быть достаточно. Особенно если нагрузка предсказуемая и не требует длинного контекста.

Сильная сторона A30 — разделение ресурсов. Одну карту можно делить между несколькими задачами или пользователями, если сценарий это поддерживает. Для инфраструктуры это удобно: не каждый сервис получает всю карту целиком, а ресурсы распределяются более аккуратно. Это важно для компаний, где GPU нужна разным командам, но никто не использует ее постоянно на полную мощность.

Еще один плюс — умеренное энергопотребление. Сервер с A30 проще вписать в существующую инфраструктуру, чем плотную конфигурацию с несколькими старшими ускорителями. Меньше требования к питанию, меньше тепловая нагрузка, проще охлаждение. Для офиса, небольшой серверной или стойки с ограничением по питанию это может быть решающим аргументом.

Но A30 не стоит выбирать, если уже сейчас планируются крупные языковые модели, длинный контекст, активная генерация для многих пользователей, тяжелое дообучение или быстрый рост нагрузки. В таком случае экономия может быстро превратиться в необходимость менять сервер раньше, чем планировалось.

Когда L40S закрывает задачу без переплаты

L40S часто становится компромиссом между «слишком мало» и «слишком дорого». Это хороший вариант для компаний, которым нужен универсальный сервер: внутренний помощник, поиск по документам, умеренный инференс, видеоаналитика, рендеринг, 3D-графика и несколько прикладных сервисов.

48 ГБ видеопамяти дают заметно больше свободы, чем 24 ГБ. Это важно для моделей среднего класса, поиска по базе знаний, обработки документов и сценариев, где нужно держать в памяти не только модель, но и рабочие данные. Однако 48 ГБ не превращают L40S в замену H200. Если задача требует сотни гигабайт видеопамяти или высокой пропускной способности HBM, класс карты должен быть другим.

L40S особенно уместна там, где нагрузка смешанная. Например, компания запускает внутренний чат-бот, систему поиска по документам, обработку изображений и периодические задачи визуализации. В такой ситуации покупка H100 ради одного направления может быть избыточной, а L40S позволит закрыть несколько сценариев на одном сервере.

Но L40S тоже нельзя выбирать только по названию. Нужно проверять корпус, питание, охлаждение и совместимость с сервером. Карта потребляет до 350 Вт, и это не единственный источник тепла в системе. Рядом будут процессоры, память, диски, вентиляторы и сетевые адаптеры. Если сервер не рассчитан на такую конфигурацию, проблема проявится не сразу: сначала вырастет шум, затем снизятся частоты, потом появятся просадки по скорости.

L40S не стоит выбирать, если задача заранее описана как тяжелое обучение крупных моделей, инференс с очень высокой параллельностью или сервис, где задержка критична для бизнеса. В этих случаях переплата за H100/H200 может быть оправданной не статусом карты, а экономией времени и снижением риска.

Где уместна RTX Pro

RTX Pro нужно рассматривать осторожно, потому что это название семейства, а не одной карты. Для серверного выбора в 2026 году показателен класс RTX PRO 6000 Blackwell Server Edition. Ее смысл — не только в искусственном интеллекте, а в сочетании вычислений, графики, видео и профессиональной визуализации.

Такая карта интересна там, где сервер должен делать несколько видов работы. Например, инженерная команда использует виртуальные рабочие станции, дизайнеры запускают рендеринг, аналитики обрабатывают изображения, а разработчики тестируют модели. В такой среде важны не только вычисления, но и профессиональная графика, видеокодирование, драйверы и большой запас памяти.

96 ГБ видеопамяти — серьезный аргумент. Если 48 ГБ уже не хватает, но H100/H200 покупаются только ради объема памяти, RTX Pro может оказаться более рациональной. Особенно если в нагрузке есть графика, 3D, видео или рабочие места пользователей.

Но объем памяти нельзя сравнивать в отрыве от ее типа и скорости. У RTX Pro используется GDDR-память, у H100/H200 — HBM-память с более высокой пропускной способностью. Поэтому в тяжелом обучении, больших моделях и задачах, где данные постоянно проходят через память, H100/H200 могут быть значительно эффективнее. RTX Pro может заменить старшую AI-карту только там, где нужна универсальность, графика и большой объем памяти, но не максимальная скорость HBM.

Для чистого обучения крупных моделей RTX Pro обычно не лучший первый выбор. Для смешанной инфраструктуры, где искусственный интеллект идет рядом с визуальными задачами, она может быть очень сильным вариантом.

Когда без H100/H200 лучше не экономить

H100 и H200 нужны не всем, но есть сценарии, где экономия на классе GPU приводит к плохому результату. Главный признак — задача упирается в память, скорость памяти, параллельность или время выполнения.

Если модель не помещается в доступную видеопамять с нужным запасом, сервер будет постоянно требовать компромиссов. Придется уменьшать контекст, снижать число одновременных запросов, использовать более компактную модель или переносить часть данных в оперативную память. Иногда это допустимо. Но если качество сервиса зависит от длинного контекста и стабильного времени ответа, такие компромиссы быстро становятся проблемой.

H100/H200 также оправданы при обучении и тяжелом дообучении. В этих задачах важна не только видеопамять, но и скорость вычислений, пропускная способность памяти, связь между ускорителями и способность работать под длительной нагрузкой. Если команда постоянно экспериментирует с моделями, каждые лишние часы обучения превращаются в реальные затраты.

H200 особенно интересен там, где H100 уже близок к пределу по памяти. 141 ГБ HBM3e позволяют держать более крупные модели, большие пакеты данных или длинный контекст. Но если задача легко помещается в H100 и не упирается в память, переход на H200 не всегда даст выгоду, пропорциональную цене.

Еще один важный случай — критичный многопользовательский сервис. Если сервер обслуживает десятки или сотни пользователей, задержка влияет на работу отдела, а простой стоит дорого, покупка более мощной платформы может быть оправданной. Здесь нужно считать не только цену GPU, но и стоимость медленных ответов, очередей, ошибок и вынужденных ограничений.

H100/H200 лучше выбирать для выделенного AI-сервера или кластера. Если сервер нужен «для всего понемногу», старший класс может оказаться дорогим и недостаточно универсальным. Если же нагрузка постоянная, тяжелая и хорошо загружает ускорители, экономить на них опаснее, чем переплатить.

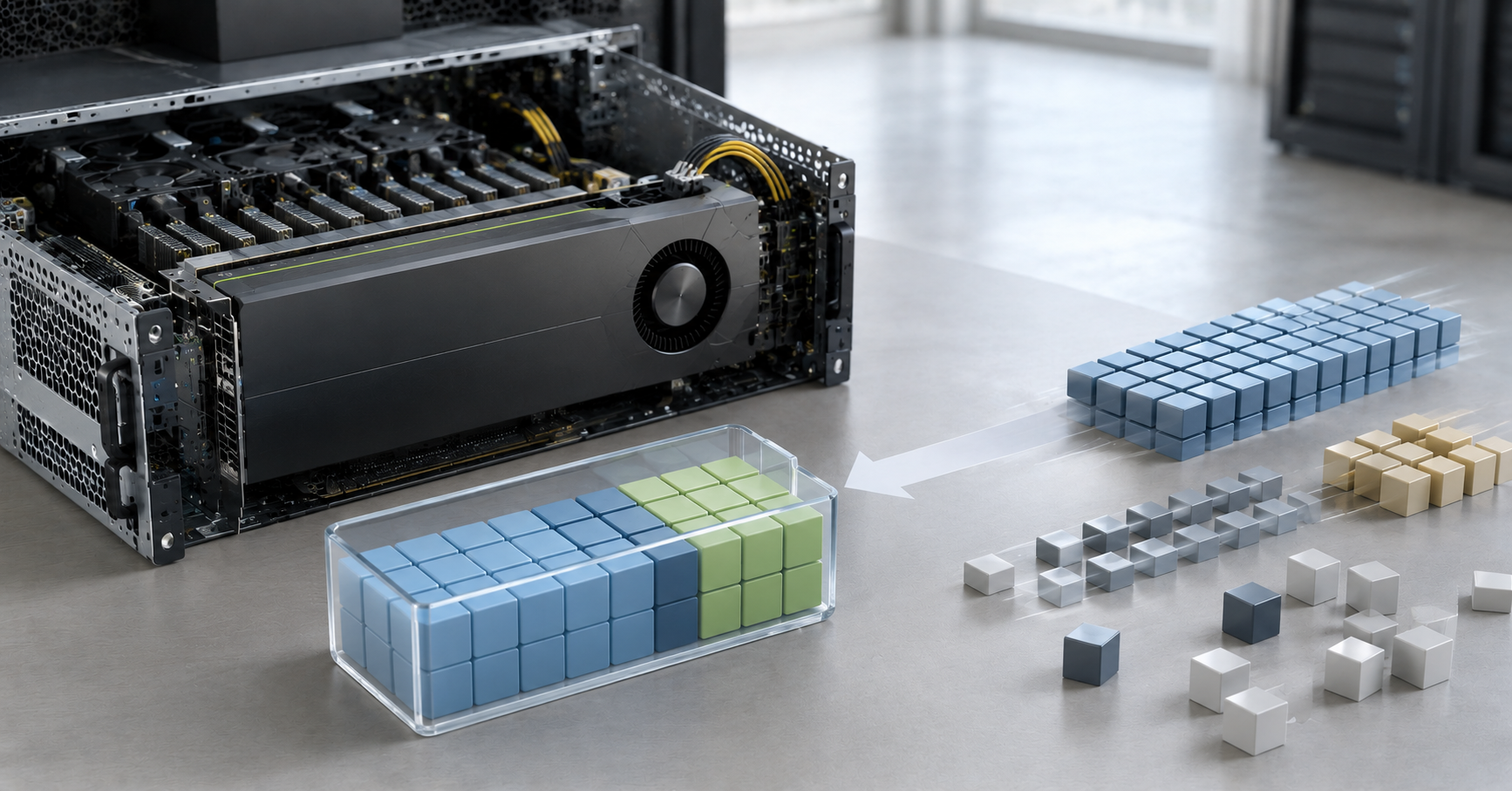

Неочевидные ограничения: память, шина, питание и охлаждение

Видеопамять — первый ресурс, который нужно считать. В нее помещаются не только веса модели. Там же находятся кэш, временные данные, служебные структуры, параллельные запросы и запас под пиковые ситуации. Поэтому расчет «модель весит 40 ГБ, значит карты на 48 ГБ хватит» часто слишком оптимистичен. Нужен запас, особенно если пользователи работают с длинными документами или несколькими сессиями одновременно.

Скорость памяти не менее важна. Две разные карты могут иметь одинаковый объем, но разную пропускную способность. Для рендеринга, графики или некоторых прикладных задач это может быть не главным фактором. Для тяжелого обучения и крупных языковых моделей память с высокой пропускной способностью часто становится решающим преимуществом H100/H200.

PCIe и топология платформы — скрытая причина многих ошибок. В спецификации сервера может быть несколько физических слотов, но это не означает, что каждый слот получает полный набор линий. Часть линий могут занимать NVMe-диски, сетевые карты, контроллеры или другие устройства. В двухпроцессорных системах важно, к какому процессору ближе конкретная GPU. Если топология неудачная, дорогие ускорители будут обмениваться данными с лишними задержками.

Питание нужно считать по всему серверу. Нельзя взять мощность GPU, умножить на количество карт и считать расчет завершенным. Процессоры, память, диски, вентиляторы, сетевые карты, системная плата и потери тоже потребляют энергию. Плюс нужен запас на пиковые нагрузки и резервирование. Для мощных GPU-серверов может потребоваться не только другой блок питания, но и другая схема подключения в стойке.

Охлаждение — не формальность. Серверная карта может физически войти в слот, но не подходить по теплу. Пассивные серверные ускорители рассчитывают на мощный направленный поток воздуха. Если корпус, вентиляторы, кожухи и заглушки подобраны неправильно, карта будет перегреваться. Перегрев не всегда выглядит как авария. Часто он проявляется снижением частот, нестабильной скоростью, ростом шума и другими проблемами, особенно летом.

Отдельно нужно учитывать место установки. Сервер с несколькими старшими GPU — это не «мощный компьютер под столом». Это источник шума, тепла и высокой нагрузки на электропитание. Если оборудование ставится не в дата-центр, а в офисную серверную, требования к вентиляции, кондиционированию и электрике нужно проверить до покупки.

Признаки переплаты и признаки нехватки GPU

| Ситуация | Что это значит | Какой вывод |

|---|---|---|

| GPU редко загружена, пользователи обращаются к сервису эпизодически | ресурс простаивает | H100/H200 могут быть избыточны |

| Модель не помещается в память с нужным контекстом | ограничение по видеопамяти | нужна карта с большим объемом памяти |

| Ответы замедляются при росте параллельных запросов | упор в кэш, память или очередь | рассмотреть H100/H200 или несколько GPU |

| Основная нагрузка — рендеринг и виртуальные рабочие станции | важны графика и драйверы | RTX Pro или L40S часто логичнее |

| Нужно обучать крупные модели | требуется высокая скорость памяти и масштабирование | H100/H200 оправданы |

| Сервер стоит в офисной комнате | есть ограничения по шуму, теплу и питанию | старшие GPU могут создать проблемы |

| Требуется один универсальный сервер | нагрузка смешанная | L40S или RTX Pro часто выгоднее |

| Сервис критичен для бизнеса и работает постоянно | простой и задержки дороги | экономия на GPU может быть ложной |

Хороший выбор обычно виден не по одной строке, а по сочетанию признаков. Если сервер должен обслуживать умеренный инференс, графику и несколько рабочих мест, универсальная карта может быть выгоднее. Если же каждый признак указывает на память, скорость и параллельность, лучше сразу смотреть в сторону старшего класса.

Как выбрать GPU-сервер по шагам

Сначала нужно описать задачу. Это инференс языковой модели, компьютерное зрение, рендеринг, обучение, виртуальные рабочие станции или смешанная нагрузка? Один и тот же сервер не обязан одинаково хорошо закрывать все сценарии.

Затем нужно определить модель или приложение. Для языковой модели важны ее размер, точность хранения, длина контекста и число пользователей. Для графики — требования приложения, драйверы и объем сцены. Для видео — количество потоков, разрешение и кодеки. Для обучения — объем данных, частота экспериментов и допустимое время выполнения.

После этого нужно посчитать пользователей и параллельность. Не только «сколько человек в компании», а сколько из них работает одновременно, какие запросы они отправляют, какой ответ считается приемлемым и что происходит в пиковые часы. Один пользователь с большим документом может создать больше нагрузки, чем несколько коротких вопросов.

Дальше выбирается класс GPU. A30 подходит для умеренного инференса, виртуальных рабочих станций и задач, где важны энергоэффективность и разделение ресурсов. L40S подходит для универсального сервера с искусственным интеллектом, видео, графикой и средними моделями. RTX Pro уместна там, где кроме AI важны профессиональная графика, визуализация, рендеринг, рабочие станции и большой запас памяти. H100/H200 нужны для тяжелого обучения, крупных моделей, высокой параллельности и нагрузки, которая действительно использует HBM-память.

После выбора карты нужно проверить платформу. Достаточно ли линий PCIe? Поддерживает ли сервер нужное число GPU? Не конфликтуют ли ускорители с NVMe-дисками и сетевыми адаптерами? Есть ли подходящие riser-карты? Поддерживает ли корпус выбранный тепловой пакет?

Затем проверяются питание и охлаждение. Нужно считать весь сервер, а не только GPU. Важны блоки питания, резервирование, напряжение, стойка, распределение питания, ИБП, вентиляторы, кожухи, радиаторы и температура воздуха на входе.

Последний шаг — стоимость владения. В нее входят не только покупка карты, но и электроэнергия, охлаждение, шум, лицензии, обслуживание, запасные части, простой и будущие обновления. Иногда более дорогая GPU оказывается дешевле в эксплуатации, если она сокращает время расчетов, оптмизируя работу сотрудников. Иногда наоборот: старшая карта не окупается, потому что задача слишком легкая.

Частые ошибки при выборе

- Покупать H100/H200 только потому, что это «лучше». Старший ускоритель хорош в тяжелых задачах, но не обязан быть лучшим выбором для рендеринга, виртуальных рабочих станций или умеренного внутреннего сервиса.

- Сравнивать карты только по вычислительным показателям. Для инференса часто важнее видеопамять, кэш и параллельность. Для графики — драйверы и поддержка приложений. Для обучения — скорость памяти и масштабирование.

- Игнорировать длину контекста. Короткий вопрос и большой документ с длинным ответом создают разную нагрузку на одну и ту же модель. Если пользователи будут загружать договоры, инструкции, код или отчеты, память нужно считать с запасом.

- Думать, что RTX Pro и H100 решают одинаковые задачи. RTX Pro сильна в универсальных и визуальных сценариях. H100/H200 сильны в тяжелом искусственном интеллекте и расчетах. Иногда они пересекаются, но не заменяют друг друга полностью.

- Не проверять корпус и охлаждение. Совместимость по слоту не равна совместимости по теплу. Карта может установиться физически, но работать нестабильно или снижать частоты.

- Забывать про питание. Несколько GPU высокого класса могут потребовать другую электрическую инфраструктуру. Это особенно важно для офисных серверных, где запас по питанию и охлаждению часто ограничен.

- Покупать несколько GPU, не проверив топологию. Если платформа не дает нужного числа линий, а связь между устройствами организована неудачно, многокарточная конфигурация может не раскрыть свой потенциал.

- Не учитывать лицензии и виртуализацию. Для виртуальных рабочих станций важны не только железо, но и программная поддержка, драйверы, права использования и удобство управления пользователями.

Финальный вывод

A30 стоит рассматривать, если задачи умеренные, важны энергоэффективность, разделение ресурсов и нет крупных языковых моделей с длинным контекстом. Это не устаревшая «плохая» карта, а ускоритель для определенного класса корпоративных нагрузок.

L40S подходит, если нужен универсальный сервер для инференса, поиска по документам, видеоаналитики, рендеринга, 3D-графики и средних моделей. Это часто хороший способ не переплатить за H100/H200 там, где старший класс не будет загружен.

RTX Pro уместна, если кроме искусственного интеллекта важны профессиональная графика, визуализация, видео, инженерные приложения, виртуальные рабочие станции и большой объем памяти. Ее сильная сторона — универсальность, а не замена H100/H200 во всех тяжелых расчетах.

H100/H200 нужны там, где есть крупные модели, длинный контекст, высокая параллельность, обучение, постоянная нагрузка и упор в пропускную способность памяти. H200 особенно полезен, когда H100 уже ограничен объемом памяти.

Переплата начинается там, где GPU покупают по названию и из-за маркетинга. Экономия заканчивается там, где задача не помещается в память, пользователи ждут ответы, сервер перегревается или платформа не раскрывает ускорители. Правильный GPU-сервер — это не самый дорогой сервер, а конфигурация, в которой задача, память, питание, охлаждение и стоимость владения совпадают с реальной нагрузкой.

Нажимая кнопку «Отправить», я даю согласие на обработку и хранение персональных данных и принимаю соглашение